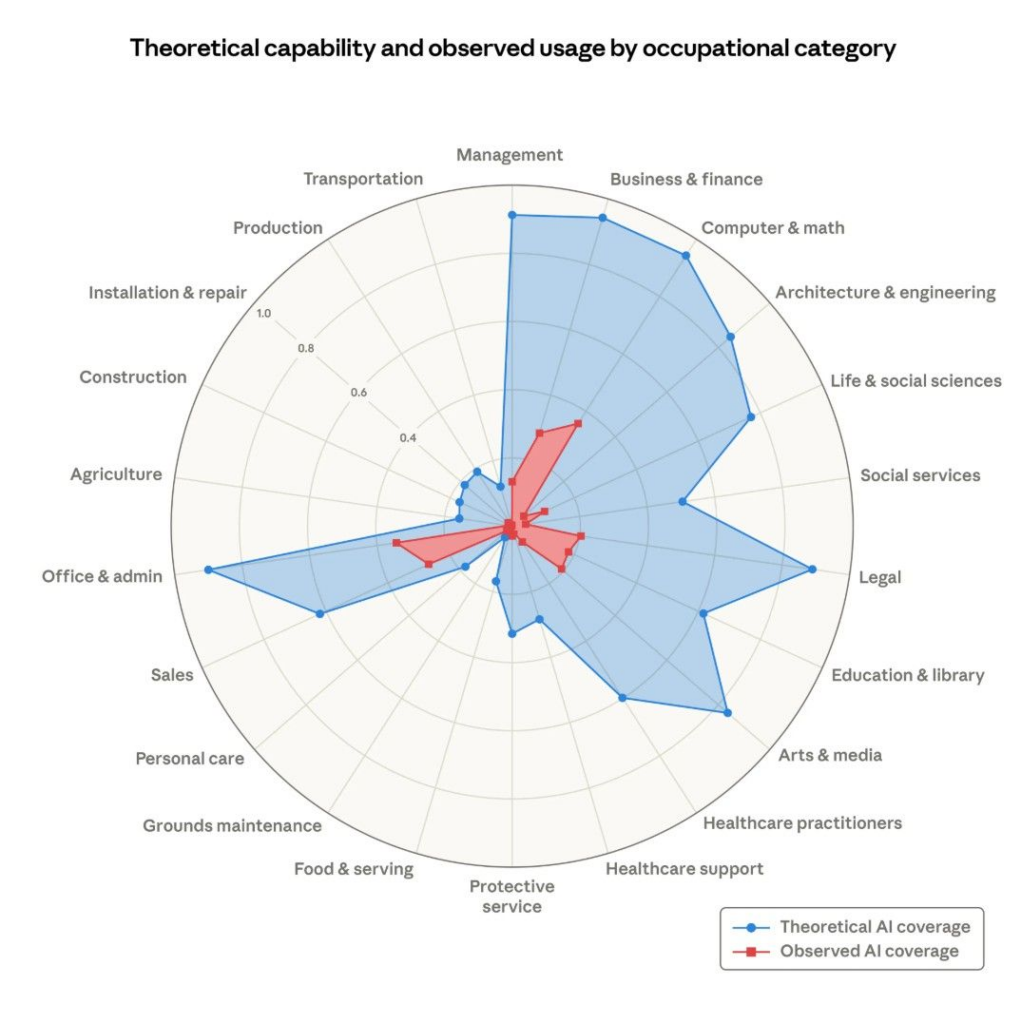

Anthropic’in yeni raporu, AI’nın yapabilecekleri ile bugün gerçek iş akışlarında fiilen yaptıkları arasında bir boşluk olduğunu söylüyor. Rapor bu mevcut kullanımı “gözlenen maruziyet” olarak adlandırıyor. Teorik LLM kapasitesini gerçek Claude kullanım verileriyle birleştiriyor ve iş odaklı ile otomasyona dönük kullanımlara daha fazla ağırlık veriyor. Temel bulgusu, AI’nın gerçek kullanımının teknolojinin teorik olarak üstlenebileceği işlerin hâlâ yalnızca küçük bir bölümünü oluşturduğu yönünde.

Bu ilk bakışta nötr bir bulgu gibi görünüyor, ancak rapor bir adım daha ileri gidiyor. AI geliştikçe ve kurumsal kullanım derinleştikçe, mevcut kullanımın daha geniş olan teorik kapasiteye doğru büyüyeceğini söylüyor. Anthropic yalnızca bir boşluğu ölçmüyor. Aynı zamanda bu boşluğun zaman içinde kapanacağını, hatta belki de kapanması gerektiğini ima ediyor.

Ancak bu yorum fazla basit kalıyor. AI kullanımının sınırlı olduğu birçok alanda mesele yavaş benimsenme değil, sorumluluk. Anthropic’in kendisi de fiili kullanımın hukuki kısıtlar, yazılım gereklilikleri ve insan doğrulaması nedeniyle teorik kapasitenin gerisinde kalabileceğini kabul ediyor. Hukuk, tıp, finans, denetim ve mühendislik gibi alanlarda bunlar küçük engeller değildir. Bunlar mesleğin temel kurallarıdır.

Bir doktor, avukat, denetçi ya da eczacı yalnızca bilgi üretmez. Bu profesyoneller eğitimlidir, sertifikalandırılmıştır ve verdikleri kararlar bakımından hukuken sorumludurlar. Kendilerine dava açılabilir, yaptırıma uğrayabilirler ya da lisansları iptal edilebilir. Bu durum, AI’dan kod yazmasını ya da bir belgeyi özetlemesini istemekten çok farklıdır. Anthropic, potansiyel ile fiili kullanım arasındaki boşluğu doldurulmayı bekleyen bir alan gibi ele aldığında, mesleki güvenceleri kaçırılmış bir teknolojik fırsatla karıştırma riski taşıyor.

Grafikteki bazı boş alanlar, AI’nın henüz yeterince ilerlemediğini göstermiyor olabilir. Tam tersine, bazı kurumların önemli kararların insan muhakemesi ve hukuki sorumlulukla bağlantılı kalmasında ısrar ettiğini gösteriyor olabilir. Böyle ortamlarda AI’nın daha yavaş benimsenmesi geri kalmışlığın işareti değildir. Bir koruma mekanizması olabilir. Ve bu koruma önemlidir, çünkü tek başına kapasite en zor soruya cevap vermez: sistem hata yaptığında sorumluluğu kim üstlenecek?

No responses yet